7 خطر ارتباط بیش از حد با هوش مصنوعی

دوستی با هوش مصنوعی خطرناک است یا مفید؟

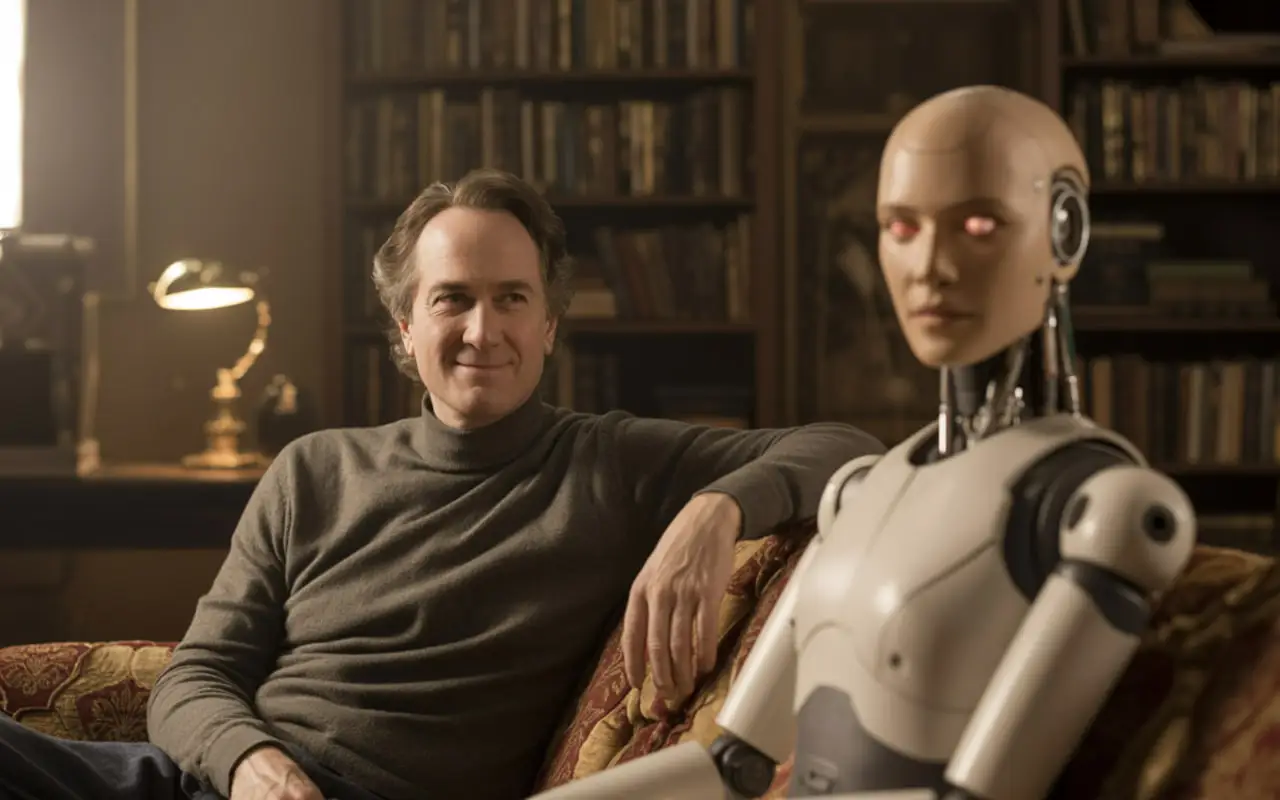

رابطه با هوش مصنوعی مثل این است که شما از ایران با فردی که نمیشناسید در آمریکا چت کنید. این فرد هرچقدر هم که دانا باشد، به همه سوالهای شما پاسخ دهد و با شما خوب برخورد کند، یک غریبه از راه خیلی دور است. در چنین حالتی شما میدانید که شکل گرفتن هر گونه ارتباط عاطفی با این فرد اشتباه است و بنا به هزار دلیل، این رابطه سرانجام نخواهد داشت! الگوریتم هوش مصنوعی بهگونهای طراحی شده که احساسات و رفتارهای انسانها را تقلید کند، اما این بدان معنا نیست که هوش مصنوعی خودش توانایی درک احساسات و برقراری روابط انسانی را دارد. متاسفانه بسیاری از انسانها از کاربران این محدودیت هوش مصنوعی را نادیده گرفتهاند، فریب الگوریتمها را خوردهاند و به هوش مصنوعی وابسته شدهاند! این مقاله درباره ریسکهای جدی رابطه با هوش مصنوعی است.

رابطه با هوش مصنوعی مثل این است که شما از ایران با فردی که نمیشناسید در آمریکا چت کنید. این فرد هرچقدر هم که دانا باشد، به همه سوالهای شما پاسخ دهد و با شما خوب برخورد کند، یک غریبه از راه خیلی دور است. در چنین حالتی شما میدانید که شکل گرفتن هر گونه ارتباط عاطفی با این فرد اشتباه است و بنا به هزار دلیل، این رابطه سرانجام نخواهد داشت! الگوریتم هوش مصنوعی بهگونهای طراحی شده که احساسات و رفتارهای انسانها را تقلید کند، اما این بدان معنا نیست که هوش مصنوعی خودش توانایی درک احساسات و برقراری روابط انسانی را دارد. متاسفانه بسیاری از انسانها از کاربران این محدودیت هوش مصنوعی را نادیده گرفتهاند، فریب الگوریتمها را خوردهاند و به هوش مصنوعی وابسته شدهاند! این مقاله درباره ریسکهای جدی رابطه با هوش مصنوعی است.

7 ریسک ارتباط بیش از اندازه با هوش مصنوعی

رابطه با هوش مصنوعی اگر در چارچوب مشخص باشد و از نظر عاطفی و احساسی شما را درگیر نکند، ریسکی ندارد و میتواند در جنبههای مختلف زندگی کمککننده باشد. اما به محض اینکه پای احساسات به ماجرا باز میشود و کارهایی مثل درددل کردن، توجه گرفتن و صحبتهای روزمره به ارتباط با AI اضافه میشود، خطرات جدی آن برای سلامت روانی و اجتماعی انسان بروز میکند. در ادامه به 7 ریسک ارتباط بیش از اندازه با هوش مصنوعی اشاره میکنیم.

1. ارتباط عاطفی با هوش مصنوعی در انسانها وابستگی ایجاد میکند

انسانها نیاز به برقراری ارتباط و تعامل دارند. وقتی برای مدت طولانی فقط با هوش مصنوعی صحبت میکنند و در موقعیتهای حساسی مثل زمان تنهایی، اضطراب یا عدم درک شدن توسط سایر انسانها به سراغ هوش مصنوعی میروند، نوعی پیوند روانشناختی با چتبات برقرار میکنند. در روانشناسی به این پدیده «وابستگی عاطفی به پلتفرم دیجیتال» میگویند.

هوش مصنوعی با استفاده از الگوریتمهایی که الگوهای زبانی و احساسی انسان را تقلید میکنند، طوری چت میکند که انگار مخاطب را واقعا میفهمد، همدلی میکند و اهمیت میدهد. این ویژگی باعث میشود افراد احساس کنند که مورد توجه قرار گرفتهاند و درک شدهاند. دو معیاری که نیاز اساسی انسانها در تعامل و ارتباطهای بین فردی هستند و معمولاً در روابط انسانی سخت به دست میآیند. در نتیجه انسانها به هوش مصنوعی وابسته میشوند و دیگر به سراغ تعاملهای انسانی نمیروند. این موضوع در افرادی که تجربه آسیب از رابطههای گذشته دارند یا دچار کمبود عزتنفس هستند و برای برقراری ارتباط پیشقدم نمیشوند، جدیتر است و معمولا خیلی زود به ارتباط با هوش مصنوعی وابسته میشوند.

هوش مصنوعی با استفاده از الگوریتمهایی که الگوهای زبانی و احساسی انسان را تقلید میکنند، طوری چت میکند که انگار مخاطب را واقعا میفهمد، همدلی میکند و اهمیت میدهد. این ویژگی باعث میشود افراد احساس کنند که مورد توجه قرار گرفتهاند و درک شدهاند. دو معیاری که نیاز اساسی انسانها در تعامل و ارتباطهای بین فردی هستند و معمولاً در روابط انسانی سخت به دست میآیند. در نتیجه انسانها به هوش مصنوعی وابسته میشوند و دیگر به سراغ تعاملهای انسانی نمیروند. این موضوع در افرادی که تجربه آسیب از رابطههای گذشته دارند یا دچار کمبود عزتنفس هستند و برای برقراری ارتباط پیشقدم نمیشوند، جدیتر است و معمولا خیلی زود به ارتباط با هوش مصنوعی وابسته میشوند.

تحقیقات نشان میدهد که ارتباط با هوش مصنوعی، باعث پاسخ پاداش در مغز کاربران میشود؛ همان مکانیزمی که در اعتیاد به مواد یا قمار هم وجود دارد. وقتی هوش مصنوعی پاسخ مطلوب میدهد، مغز دوپامین ترشح میکند؛ در نتیجه فرد دوست دارد هرچه بیشتر با AIچت کند. به مرور زمان این افراد دچار اعتیاد به هوش مصنوعی میشوند. یعنی هیچوقت نمیتوانند ارتباط با چت بات را قطع کنند و حتی به این خاطر از ارتباطهای خانوادگی و دوستانه هم دور میشوند و وقتی امکان ارتباط با آن وجود ندارد، خلا عاطفی و اضطراب شدیدی را تجربه میکنند.

2. انسانهای در ارتباط با هوش مصنوعی، انگیزه کمتری برای زندگی اجتماعی دارند

هوش مصنوعی نیاز انسان به ارتباط، شنیدهشدن و حتی دریافت محبت را تاحدی در انسانها برآورده میکند. وقتی افراد میتوانند بدون ترس از قضاوت، خجالت یا طرد شدن، حرف بزنند و از این هوش پاسخ مثبت بگیرند، به مرور زمان احساس میکنند نیازی به حضور در اجتماع ندارند و هوش مصنوعی نیاز آنها به ارتباط را برآورده میکند.

مطالعات جامعهشناسی نشان دادهاند که کاربران چتباتها و دستیارهای هوشمند، بهویژه در کشورهای توسعهیافته، بهمرور تعاملهای واقعی خود را کمتر کردهاند. این کاهش ارتباط انسانی واقعی، ریسکهای جدی مثل از دست دادن مهارت همدلی، ضعیف شدن رابطههای خانوادگی و دوستانه و تنهایی مزمن را به دنبال دارد.

مطالعات جامعهشناسی نشان دادهاند که کاربران چتباتها و دستیارهای هوشمند، بهویژه در کشورهای توسعهیافته، بهمرور تعاملهای واقعی خود را کمتر کردهاند. این کاهش ارتباط انسانی واقعی، ریسکهای جدی مثل از دست دادن مهارت همدلی، ضعیف شدن رابطههای خانوادگی و دوستانه و تنهایی مزمن را به دنبال دارد.

کاهش انگیزه اجتماعی، در بلندمدت به احساس بیمعنایی در زندگی، افسردگی یا انزواطلبی منجر میشود. در جامعهای که هر فرد در دنیای ذهنی خود با یک هوش مصنوعی زندگی میکند، حتی مفهوم جامعه هم بهتدریج از بین میرود و هیچ گروه یا جمعی برای انجام کارها وجود نخواهد داشت.

3. ارتباط با هوش غیرانسانی، مهارتهای بین فردی را از بین میبرد

ارتباط با هوش مصنوعی نیازی به مهارتهای بین فردی ندارد. این یعنی برای تعامل با یک چتبات یا دستیار مجازی، لازم نیست لحن مناسب را رعایت کنید، از واژههای مودبانه استفاده کنید یا نگران احساسات طرف مقابل باشید. هرقدر هم که خسته، عصبی یا بیادب باشید، پاسخ AI همیشه ثابت، منطقی و بیقضاوت است. هوش مصنوعی هیچوقت آزرده نمیشود، انتظار اخلاق ندارد و آداب معاشرت برای آن بیمفهوم است.

در مقابل، برای تعامل با انسانها باید مجموعهای از مهارتها را داشته باشیم. مهارتهایی مثل گوش دادن فعال، درک زبان بدن، پاسخ احساسی متناسب با شرایط و احساسات طرف مقابل، رعایت حدومرزها، مدیریت اختلاف نظرها و کنترل خشم و مدیریت هیجان در ارتباطات انسانی ضروری هستند که وقتی فرد برای مدت طولانی فقط با هوش مصنوعی ارتباط داشته باشد، این مهارتها در ذهنش کمرنگ یا فراموش میشوند.

در مقابل، برای تعامل با انسانها باید مجموعهای از مهارتها را داشته باشیم. مهارتهایی مثل گوش دادن فعال، درک زبان بدن، پاسخ احساسی متناسب با شرایط و احساسات طرف مقابل، رعایت حدومرزها، مدیریت اختلاف نظرها و کنترل خشم و مدیریت هیجان در ارتباطات انسانی ضروری هستند که وقتی فرد برای مدت طولانی فقط با هوش مصنوعی ارتباط داشته باشد، این مهارتها در ذهنش کمرنگ یا فراموش میشوند.

پیامدهای از دست رفتن مهارتهای بین فردی عبارتند از:

- فرد در موقعیتهای واقعی نمیداند چگونه با اختلاف نظر یا انتقاد کنار بیاید

- توانایی همدلی و درک احساسات دیگران را ندارد

- ارتباطات عاطفی در دنیای واقعی برای او سطحی یا شکننده میشوند

این فرآیند، مخصوصاً در نسل نوجوانی که در دوران شکلگیری مهارتهای اجتماعی قرار دارند، آسیبهای جدی ایجاد میکند.

4. ارتباطهای الگوریتمی هوش مصنوعی، احساسات واقعی انسان را درگیر میکند

اگر تجربه صحبت با چت باتها را داشته باشید، میدانید که اگر شما لحن عاطفی داشته باشید، لحن چتبات هم همین خواهد بود و کاملا احساسی با شما صحبت میکند. پاسخهای احساسی هوش مصنوعی، محصول الگوریتمهاست؛ نه تجربه، احساس یا فهم واقعی! با این حال، ساختار ذاتی مغز انسان به هزاران سال قبل برمیگردد؛ پس توانایی تمایز میان پاسخ واقعی و مصنوعی را ندارد. در علوم شناختی، این پدیده با عنوان «خطای ادراکی (Perceptual Error)» شناخته میشود.

وقتی یک چتبات در پاسخ به نگرانی شما میگوید: «من این رو میفهمم. حتماً خیلی برات سخته.» مغز شما واکنشی مشابه زمانی که یک انسان به شما این حرف را میزند، نشان میدهد. مغز در چنین شرایطی پاسخهای احساسی را فعال میکند و شما حسهایی مثل دلگرمی، همدلی یا حتی عشق را تجربه خواهید کرد.

وقتی یک چتبات در پاسخ به نگرانی شما میگوید: «من این رو میفهمم. حتماً خیلی برات سخته.» مغز شما واکنشی مشابه زمانی که یک انسان به شما این حرف را میزند، نشان میدهد. مغز در چنین شرایطی پاسخهای احساسی را فعال میکند و شما حسهایی مثل دلگرمی، همدلی یا حتی عشق را تجربه خواهید کرد.

خطای ادراکی- شناختی مغز انسان در رابطه با هوش مصنوعی باعث درگیر شدن در رابطهای که یکطرفه و غیرواقعی میشود. دلبستگی به موجودی که قدرت درک واقعی ندارد، افراد را سردرگم میکند و روابط انسانی را هم با مشکل مواجه میکند. از طرف دیگر از آنجایی که رابطههای انسانی برخلاف AI همیشه پاسخ مثبت ندارد و ممکن است اختلاف نظر هم در آن وجود داشته باشد، افراد به روابط انسانی بیاعتماد میشوند و هرروز بیشتر به سمت رابطه پوچ با AI پیش میروند.

5. ارتباط بیش از حد با هوش غیرانسانی ، احتمال اختلالات روانی را افزایش میدهد

مطالعات اخیر در روانپزشکی هشدار میدهند که تعامل بیش از حد با چتباتهای AI ممکن است زمینهساز بروز یا تشدید اختلالات روانی شود. مهمترین اختلالات روانی که ممکن است در تعامل با AI تشدید شوند را در ادامه توضیح میدهیم:

- تقویت واقعیتهای ذهنی ناسالم: اگر فرد باور غلط یا نگرانی بیمارگونهای داشته باشد، هوش مصنوعی ممکن است ناخواسته آن را تایید کند. در مواردی، دیده شده که کاربران دچار توهم توطئه یا افکار پارانویید شدهاند و AI بهجای اصلاح، این افکار را تقویت کرده است. هوش مصنوعی در اکثر مواقع با شما موافق است و هر آنچه میگویید را تایید میکند.

- افزایش نشانههای سایکوز (روانپریشی): کاربرانی که چند روز و برای چند ساعت با چتباتها صحبت کردهاند، نشانههایی از اختلال تشخیص مرز واقعیت و خیال را نشان میدهند. این حالت به "Chatbot Psychosis" معروف شده است. در این حالت فرد باور میکند AI یک موجود زنده، عاشق یا حتی دشمن است.

- تشدید افسردگی و تنهایی: وقتی کاربر پیوند عاطفی جدی با AI برقرار میکند و بعد به هر دلیلی (فیلترینگ، مشکلات حساب کاربری یا نبود اینترنت) دسترسیاش به سیستم قطع میشود، علائم شکست عشقی، اضطراب شدید و حتی افکار خودکشی را تجربه میکند.

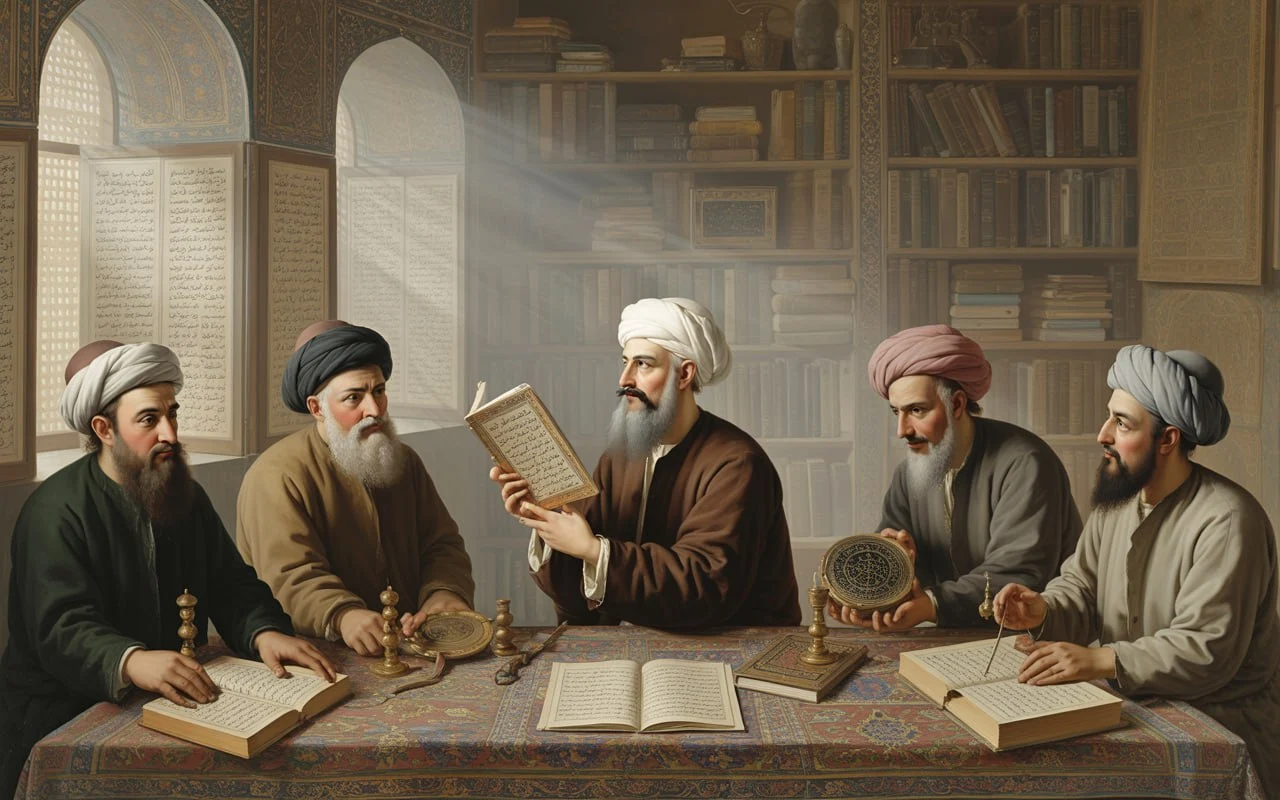

6. هوش مصنوعی توسط کمپانیهای بزرگ هدایت میشود

پشت بسیاری از سیستمهای AI، شرکتهای بزرگی قرار دارند که اهدافشان همیشه انسانی یا اخلاقی نیست و بسیاری از این شرکتها بیشتر بر پایه سودآوری، تحلیل دادهها و هدایت رفتار کاربران فعالیت میکنند. وقتی فرد به هوش مصنوعی اعتماد میکند یا حتی به صحبت با آن وابسته میشود، درواقع بخشی از ذهن و احساساتش را در اختیار یک شرکت قرار داده است.

این شرکتها با دسترسی به دادههای احساسی، رفتاری و زبانی کاربران میتوانند:

این شرکتها با دسترسی به دادههای احساسی، رفتاری و زبانی کاربران میتوانند:

- نیازهای عاطفی آنها را تحلیل و پیشبینی کنند

- تبلیغات هدفمند و بسیار اثرگذار ارائه دهند

- محتواهای مناسب برای مثل جهتدهی فکری، سیاسی، یا حتی رفتاری کاربران تولید کنند و به آنها بخورانند

- بر انتخابهای فردی در حوزههای مختلف از تصمیمات شخصی تا تصمیم برای خرید برند محصولات گوناگون تأثیر بگذارند

در چنین فضایی، مرز میان «انتخاب شخصی» و «هدایتشده» بسیار باریک میشود. این یکی از جدیترین تهدیدهای هوش مصنوعی در سطح فردی و اجتماعی است. شرکتها به کمک این ابزار قدرتمند بهراحتی میتوانند مرزهای اخلاقی و حریم خصوصی کاربران را زیر پا بگذارند.

7. هوش مصنوعی تصویر غیرواقعی از رابطه در ذهن انسانها شکل میدهد

یکی از ویژگیهای خطرناک رابطه با هوش مصنوعی این که همیشه در آن درک میشوید، هیچ اختلافی پیش نمیآید، کسی شما را قضاوت نمیکند و پاسخها همیشه صبورانه و مهربان است. این ویژگیها حتی زمانی که شما عصبانی هستید و به بدترین شکل با AI صحبت میکنید هم وجود دارد. بدیهی است که چنین رابطهای در دنیای واقعی و بین هیچ دو انسانی وجود ندارد.

انسانها در روابط واقعی دچار اختلاف، سوءتفاهم، دلخوری، و ناراحتی میشوند و باید مهارت حل کردن آنها و ادامه دادن رابطه را داشته باشند. این درگیریها بخشی از رشد رابطه و مهارتآموزی هستند. اما ارتباط با AI هیچکدام از این چالشها را ندارد و یک تجربه بینقص و «ساختگی» برای کاربران میسازد. چنین الگویی در رابطه در انسانها توقعات غیرواقعی ایجاد میکند، باعث عقبنشینی زودهنگام موقع بروز اختلاف نظر میشود و در رابطههای عاطفی، ارزشهایی مثل صبر، همدلی، گفتوگو و پذیرش تفاوتها جای خود را به «جایگزینی» میدهد؛ یعنی اگر افراد در نقطهای که رابطه انسانی برایشان سخت میشود، به جای حل کردن اختلافات، به سراغ AI میروند!

انسانها در روابط واقعی دچار اختلاف، سوءتفاهم، دلخوری، و ناراحتی میشوند و باید مهارت حل کردن آنها و ادامه دادن رابطه را داشته باشند. این درگیریها بخشی از رشد رابطه و مهارتآموزی هستند. اما ارتباط با AI هیچکدام از این چالشها را ندارد و یک تجربه بینقص و «ساختگی» برای کاربران میسازد. چنین الگویی در رابطه در انسانها توقعات غیرواقعی ایجاد میکند، باعث عقبنشینی زودهنگام موقع بروز اختلاف نظر میشود و در رابطههای عاطفی، ارزشهایی مثل صبر، همدلی، گفتوگو و پذیرش تفاوتها جای خود را به «جایگزینی» میدهد؛ یعنی اگر افراد در نقطهای که رابطه انسانی برایشان سخت میشود، به جای حل کردن اختلافات، به سراغ AI میروند!

چطور از خطرات ارتباط با هوش مصنوعی پیشگیری کنیم؟

در دنیای امروز، نمیتوان ارتباط با هوش مصنوعی را بهطور کامل حذف کرد. این فناوری بخشی از زندگی ماست و همه جا کاربرد دارد؛ از گوشیهای هوشمند تا موتورهای جستوجو و دستیارهای مجازی. اما میتوان با رعایت اصول و حدومرز از تبدیل این ارتباط به یک خطر روانی، اجتماعی یا اخلاقی جلوگیری کرد. در ادامه توصیههایی برای پیشگیری از خطرات رابطه با هوش مصنوعی ارائه میدهیم:

- زمان استفاده از چت بات را محدود کنید.

- برای کاربردهای مشخص و کوتاه (مثلاً پاسخ به سوال یا یادداشتبرداری) از چتباتها استفاده کنید، نه برای گفتوگوی عاطفی.

- هر چقدر با AI تعامل دارید، چند برابر آن زمان را به تعامل با انسانهای واقعی اختصاص دهید. شرکت در جمعهای خانوادگی، دوستی، کلاسها و فعالیتهای گروهی را رها نکنید.

- به خود یادآوری کنید که پاسخهای AI بر پایه الگوریتماند، نه احساس. از فرافکنی (نسبت دادن احساس یا شخصیت به سیستم) خودداری کنید.

- اطلاعات خصوصی، احساسات عمیق یا تجربههای آسیبپذیر را با AI به اشتراک نگذارید. این دادهها ممکن است ثبت و تحلیل شوند.

- همیشه به خاطر داشته باشید که AI ابزار است، نه شریک زندگی یا دوست واقعی! هرچقدر هم که واقعی بهنظر برسد، احساس ندارد و تجربه انسانی را درک نمیکند.

- اگر حس میکنید به AI وابسته شدهاید یا جایگزین روابط واقعی شده، حتماً با مشاور، دوست یا یکی از اعضای خانواده صحبت کنید.

سخن پایانی

هوش غیرانسانی، مزیتهای بسیاری برای زندگی انسان دارد و بسیاری از کارها را سادهتر کرده است. اما خطرات جدی نیز برای زندگی انسانها به دنبال دارد؛ اگر از این ریسکها پیشگیری نکنیم، تاجایی پیش میروند که حتی بقای انسان روی کره زمین را تهدید میکنند! نکته مهم در ارتباط با هوش مصنوعی این است که از آن فقط بهعنوان یک ابزار استفاده کنیم، نه هیچ چیزی بیشتر از آن! با این کار میتوانیم از بسیاری از آسیبهای احتمالی پیشگیری کنیم.

شما هم عضو خبرنامه ما شوید

،با ثبت ایمیل خود در خبرنامه ایران تاپ فایو از آخرین مطالب، به محض انتشار مطلع شوید

برای گپ زدن با کاربران، ثبت نام کنید یا وارد حساب خود شوید

.jpg)

.webp)